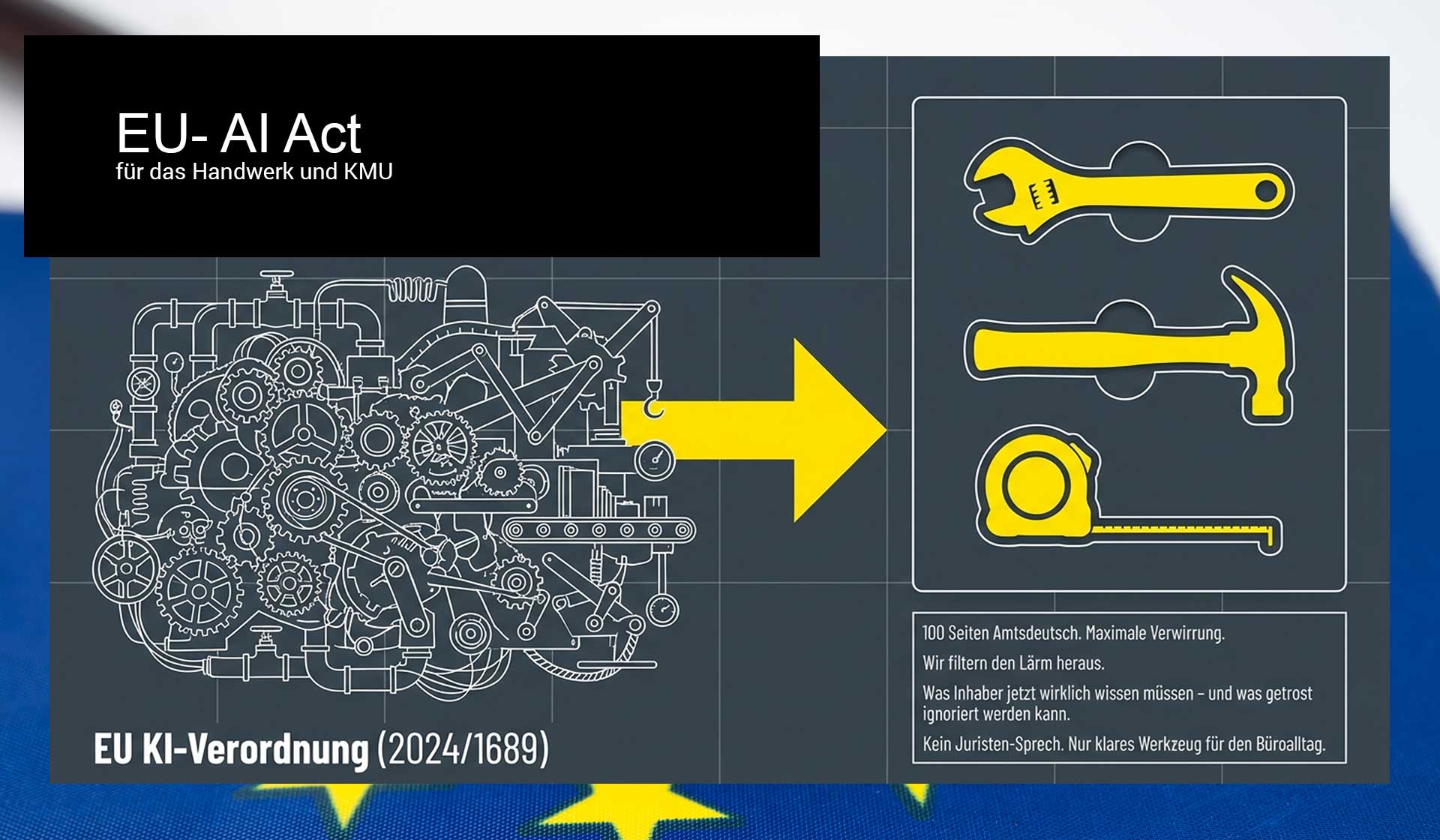

Der EU- AI Act wird oft als bürokratisches Ungeheuer porträtiert, das Innovationen im Keim erstickt. Doch für den Mittelstand und das Handwerk entpuppt sich das Gesetz bei genauerer Betrachtung als präzises Regulierungswerkzeug, das vor allem die Tech-Giganten in die Pflicht nimmt. Während 95 % der Regeln die Entwickler großer Modelle betreffen, erhalten Anwender klare Leitplanken für den sicheren Einsatz von KI im Betriebsalltag. Dieser Artikel filtert den juristischen Lärm heraus und zeigt, warum die „Risiko-Ampel“ der EU tatsächlich den Weg für eine effizientere, rechtssichere digitale Transformation ebnet.

Vom Bürokratiemonster zum Präzisionswerkzeug

In der medialen Berichterstattung wird das neue EU-KI-Gesetz oft als monumentales Hindernis dargestellt. Es herrscht die Sorge, dass Europa sich „zu Tode reguliert“, während der Rest der Welt in Lichtgeschwindigkeit voranschreitet. Doch wer den Blick von den Schlagzeilen abwendet und direkt in dieses Handbuch schaut, erkennt ein anderes Bild. Die Verordnung kein pauschales Verbot, sondern eine differenzierte Gebrauchsanweisung.

Das Ziel der EU ist es, Vertrauen zu schaffen. Denn nur wenn Unternehmer wissen, dass sie beim Einsatz von KI nicht mit einem Bein im Gefängnis oder in der Haftungsfalle stehen, werden sie die Werkzeuge auch produktiv nutzen. Wir verlassen den Modus der maximalen Verwirrung durch hunderte Seiten Amtsdeutsch und konzentrieren uns auf das, was Inhaber jetzt wirklich wissen müssen – und was sie getrost ignorieren können. Es geht nicht um „Juristen-Sprech“, sondern um klare Werkzeuge für den Büroalltag.

Der Radikal-Filter – Warum 95 % des EU- AI Act dich als Handwerker und KMU nicht betreffen

Eines der größten Missverständnisse ist der Glaube, dass jeder kleine Betrieb nun dieselben Auflagen erfüllen muss wie ein Weltkonzern. Der „Radikal-Filter“ zeigt jedoch deutlich: Die EU reguliert zwar den gesamten Planeten, aber den durchschnittlichen Handwerksbetrieb betrifft am Ende nur ein Bruchteil.

95 % des Gesetzes zielen direkt auf die Tech-Giganten ab. Die massiven Anforderungen an Transparenz, Dokumentation und Cybersicherheit müssen von denjenigen gestemmt werden, die die KI-Modelle bauen. Panik ist daher für KMU völlig unangebracht.

Um die Struktur der Verordnung zu verstehen, hilft ein Blick auf die verschiedenen Filterebenen:

- Militär & Staat: Große Teile der Regulierung befassen sich mit staatlichen Akteuren und nationaler Sicherheit.

- Großkonzerne: Unternehmen mit systemischer Relevanz stehen unter besonderer Beobachtung.

- KI-Entwickler (Provider): Akteure wie OpenAI, Google oder Microsoft tragen die Hauptlast der Regulierung.

Was am Ende des Trichters für den einzelnen Betrieb ankommt, ist lediglich ein kleiner „gelber Tropfen“ an Eigenverantwortung. Ignorieren ist zwar keine Lösung, aber die verbleibenden Aufgaben sind für ein gut geführtes Unternehmen absolut machbar.

Die Rollenverteilung – Anbieter vs. Betreiber

Das Gesetz unterscheidet knallhart zwischen zwei Rollen, die in Artikel 3 definiert werden: dem Anbieter (Provider) und dem Betreiber (Deployer). Diese Unterscheidung ist die „goldene Regel“ für die Haftungsfrage.

- Der Anbieter (Provider): Das ist das Unternehmen, das die KI baut, trainiert und in den Verkehr bringt. Provider tragen etwa 99 % der Pflichten. Sie müssen Zertifizierungen durchlaufen, umfangreiche Tests durchführen und detaillierte Risikoanalysen vorlegen. Wenn Sie Microsoft Copilot oder ChatGPT nutzen, ist Microsoft bzw. OpenAI der Provider.

- Der Betreiber (Deployer): Das sind Sie. Als Betreiber nutzen Sie fertige KI-Werkzeuge in Ihrem beruflichen Kontext. Ihre Pflichten sind minimal und orientieren sich primär am gesunden Menschenverstand. Sie brauchen keine komplexen Zertifikate, um ChatGPT zum Schreiben von Kunden-E-Mails einzusetzen.

Die Grenze verschwimmt erst dann, wenn ein Unternehmen beginnt, ein bestehendes Modell so massiv umzubauen, dass es als „wesentliche Modifizierung“ gilt. Solange Sie die Tools jedoch bestimmungsgemäß als Assistenten nutzt, bleiben Sie in der komfortablen Rolle des Betreibers.

Die Risiko-Ampel des EU-AI Act im Detail – Navigation durch den Arbeitsalltag

Die EU-KI-Verordnung sortiert Technologien nicht nach ihrer technischen Komplexität, sondern nach ihrem Einsatzort und dem damit verbundenen Risiko für Grundrechte. Je gefährlicher der Einsatzort für den Menschen ist, desto strenger fallen die Regeln aus. Um diese abstrakte Rechtsnorm in den Werkstatt-Alltag zu übersetzen, hilft das Modell der Risiko-Ampel.

Grün: Einfach machen (Minimales Risiko)

Im grünen Bereich findet Ihr normaler Arbeitsalltag statt. Hier agiert die KI als reiner Assistent für Standard-Aufgaben, die keine tiefgreifenden Auswirkungen auf die Rechte Dritter haben.

- Beispiele: ChatGPT schreibt ein Angebot auf Basis Ihrer Stichpunkte.

- Beispiele: Die KI formuliert eine freundliche Absage an einen Bewerber vor.

- Beispiele: Eine Software fasst lange PDF-Dokumente oder Montageanleitungen zusammen,

Heißt: Hier gibt es keine spezifischen EU-Regeln für dich als Nutzer. Das Gesetz lässt dich hier komplett in Ruhe

Gelb: Zeigen, was Sache ist (Transparenzpflicht)

Artikel 50 der Verordnung verlangt schlichte Ehrlichkeit. Wenn eine KI direkt mit Kunden interagiert oder Inhalte erstellt, die täuschend echt wirken, muss dies sichtbar sein.

- Beispiele: Ein Chatbot auf Ihrer Website übernimmt die erste Terminvereinbarung.

- Beispiele: Ein KI-generiertes Bild wird für einen Facebook-Post oder ein Werbebanner genutzt.

Heißt: Es besteht eine Kennzeichnungspflicht. Der Kunde muss wissen, dass er mit einer Maschine chattet oder ein künstliches Bild sieht. Ein kleiner, klarer Hinweis („KI-generiert“) reicht meist völlig aus.

Orange: Chef-Sache (Hochrisiko-KI)

Achtung ist vor allem im Personalbüro geboten (Anhang III der Verordnung). Sobald eine KI maßgebliche Entscheidungen über Menschen trifft oder diese vorbereitet, sieht die EU „orange“.

- Beispiele: Eine Software filtert eingehende Bewerbungen automatisch aus.

- Beispiele: KI sortiert Lebensläufe nach Erfolgsaussichten vor.

- Beispiele: Systeme bewerten die Leistung oder das Verhalten von Mitarbeitern.

Heißt: Hier ist eine zwingende menschliche Kontrolle gemäß Artikel 14 vorgeschrieben. Die KI darf zwar vorsortieren, aber ein Mensch muss die finale Entscheidung treffen und den Prozess überwachen. Blindes Vertrauen in die Maschine ist in diesem Bereich illegal.

Rot: Finger weg (Verbotene Praktiken)

Artikel 5 verbietet bestimmte Systeme komplett, da sie mit europäischen Werten unvereinbar sind. Dies betrifft vor allem Überwachungsszenarien mit extremem Kontrollzwang.

- Beispiele: Kamerasysteme, die Emotionen von Mitarbeitern an der Werkbank oder im Büro erkennen sollen.

- Beispiele: Systeme, die das soziale Verhalten am Arbeitsplatz bewerten (Social Scoring).

Heißt: Diese Software darf in Europa weder verkauft noch genutzt werden. Sollten Ihnen solche „Optimierungstools“ angeboten werden: Finger weg.

Matrix: Der EU-AI Act Alltags-Check für das Handwerk

Um im Büro nicht jedes Mal das Gesetzbuch aufschlagen zu müssen, dient die folgende Tabelle als schnelle Entscheidungshilfe beim Einkauf oder Einsatz neuer Software:

| Anwendungsfall | EU-Einstufung | Dein To-Do als Chef |

| ChatGPT schreibt Kunden-Mail | Grün (Minimal) | Einfach machen. |

| KI-Chatbot vergibt Termine | Gelb (Transparenz) | Nutzer informieren. |

| KI generiert Werbebilder | Gelb (Transparenz) | Als KI kennzeichnen. |

| KI sortiert Azubi-Bewerbungen | Orange (Hochrisiko) | Mensch muss final entscheiden. |

Kapitel 4 des EU- AI Act: Der versteckte Kern – KI-Kompetenz

Das Gesetz zwingt Sie nicht dazu, KI zu meiden – im Gegenteil. Der oft übersehene Artikel 4 verlangt von Betreibern, dass sie ihr Personal „fit machen“.

Unternehmer müssen sicherstellen, dass ihre Mitarbeiter über „ausreichende KI-Kompetenz“ verfügen. Wer seinen Leuten beibringt, wie man ChatGPT sicher nutzt (beispielsweise ohne sensible Kundendaten hochzuladen), handelt gesetzeskonform. Diese geforderte Schulung ist kein lästiges Übel: Sie schützt vor Fehlern, bewahrt vor Strafen und spart durch effizientere Nutzung gleichzeitig massiv Arbeitszeit ein. Regulierung wird hier direkt zur sinnvollen Personalentwicklung.

Die EU-Verordnung als Gebrauchsanweisung für den digitalen Vorsprung

Betrachtet man das EU-KI-Gesetz nüchtern, so entpuppt es sich nicht als Innovationsbremse, sondern als notwendiges Regelwerk, um Künstliche Intelligenz rechtssicher und effizient in den Betriebsalltag zu integrieren. Für Unternehmen bedeutet dies in erster Linie eine Entlastung: Da die Hauptverantwortung für Zertifizierungen und Risikoanalysen bei den großen Anbietern wie Microsoft oder Google liegt, können sich Betriebe auf die Anwendung konzentrieren. Daraus lernen wir, dass Angst vor hohen Bußgeldern bei Standardaufgaben wie dem Verfassen von E-Mails oder der Dokumentenzusammenfassung unbegründet ist, da diese in den Bereich des minimalen Risikos fallen.

Für Angestellte und Führungskräfte heißt das jedoch auch, dass Untätigkeit keine Option ist. Der oft übersehene Artikel 4 der Verordnung macht die Förderung von KI-Kompetenz zur Pflicht. Wer sein Team schult und klare Leitplanken setzt – etwa die Kennzeichnung von KI-generierten Bildern oder die menschliche Endkontrolle bei Personalentscheidungen –, schützt den Betrieb vor rechtlichen Risiken und steigert gleichzeitig die Produktivität. Letztlich ist das Gesetz eine Einladung, die Werkzeuge der Zukunft mutig zu nutzen, solange man die einfache Regel befolgt: Technik einsetzen, Regeln kennen und die Ampel auf Grün halten.

Alles zusammengefasst finden Sie auch in unserem YouTube Video zum Thema EU- AI Act für Handwerk und KMU.

Um sich selbst eine Übersicht über den EU- AI Act zu verschaffen und das Gesetzt sauber für eigene Zwecke zu verwenden, haben wir dieses als Markdowndatei aufbereitet.

Die Markdowndatei 2024-1689_EU_AI_Act_Volltext können Sie hier kostenlos herunterladen und für Ihr Unternehmen nutzen!