Wir befinden uns in einer Phase des technologischen Umbruchs, in der die Fähigkeit, Künstliche Intelligenz präzise zu steuern, zur entscheidenden Kernkompetenz wird. Dieser Artikel dekonstruiert die Mechanismen hinter modernen Large Language Models (LLMs) und zeigt auf, dass „Prompting“ weit mehr ist als das Formulieren höflicher Fragen. Es ist die gezielte Manipulation von Wahrscheinlichkeitsverteilungen im latenten Raum der Modelle. Von den fundamentalen Prinzipien des In-Context Learning (ICL) bis hin zu komplexen agentischen Architekturen wie Plan-and-Solve analysieren wir die wissenschaftliche Genese und die praktische Anwendung der leistungsfähigsten Steuerungstechniken.

Das Ende der Naivität

Wenn wir ein Chat-Fenster öffnen und eine Frage eintippen, unterliegen wir einer mächtigen Illusion. Wir glauben, wir würden mit einem Gegenüber kommunizieren, das unsere Intention „versteht“. Technisch gesehen ist dies jedoch ein Trugschluss. Ein Large Language Model (LLM) ist kein Antwort-Automat, sondern eine statistische Vorhersagemaschine, deren einziges Ziel es ist, das nächste logische Token (Wortteil) in einer Sequenz zu komplettieren.

Das Verständnis dieser fundamentalen Wahrheit verwandelt den Nutzer vom passiven Konsumenten zum „Prompt Engineer“. Wir lernen, dass ein Prompt keine Frage ist, sondern ein Kontext-Vektor, der das Modell in einen bestimmten Bereich seines riesigen neuronalen Netzwerks (den latenten Raum) zwingt. Die Qualität des Outputs hängt nicht von der „Klugheit“ der KI ab, sondern von der Präzision, mit der wir diesen Vektor ausrichten.

In diesem Deep Dive verlassen wir die Ebene der einfachen „Tipps und Tricks“. Wir betrachten Prompting als eine Form der Programmierung in natürlicher Sprache. Basierend auf bahnbrechenden Papern von OpenAI, Google Brain und Stanford werden wir Techniken untersuchen, die die Reasoning-Fähigkeiten (Schlussfolgerung) von Modellen dramatisch steigern – oft weit über das hinaus, was im ursprünglichen Training vorgesehen war.

Die Fundamente: In-Context Learning (ICL)

Bevor wir uns komplexen Algorithmen widmen, müssen wir verstehen, wie LLMs überhaupt neue Aufgaben lösen können, ohne dass ihre internen Gewichte (Parameter) verändert werden. Dieses Phänomen nennt sich In-Context Learning (ICL). Es ist der Grundstein aller modernen Prompting-Techniken.

Zero-Shot Prompting: Der Sprung ins kalte Wasser

Die intuitivste Form der Interaktion ist das Zero-Shot Prompting. Hierbei gibst du dem KI-Sprachmodell eine Aufgabe, ohne vorher Beispiele zu zeigen, wie diese gelöst werden soll. Du verlässt dich vollständig auf das Weltwissen, das das Modell während seines massiven Pre-Trainings (auf Terabytes von Textdaten) akkumuliert hat.

- Mechanismus: Das Modell muss ohne spezifisches Training auf deine Anweisung hin eine Lösung generieren. Es versucht, die Aufgabe allein durch Mustererkennung in seiner Trainingsverteilung zu bewältigen.

- Anwendungsfall: Diese Methode eignet sich hervorragend, um die Fähigkeiten des Sprachmodells initial auszutesten und sich einen schnellen Überblick zu verschaffen, für welche Aufgaben es out-of-the-box geeignet ist.

- Limitierungen: Die Ergebnisse sind oft noch nicht optimal. Ohne Leitplanken neigen Modelle hier am stärksten zu Halluzinationen oder formattechnischen Fehlern, da sie den genauen Erwartungshorizont des Nutzers „erraten“ müssen.

Few-Shot Prompting: Die Simulation von Lernen

Der eigentliche Durchbruch in der Steuerung von LLMs gelang mit der Einführung des Few-Shot Prompting. Dies ist eine Technik, bei der du dem Sprachmodell ein oder mehrere Beispiele gibst, die zeigen, wie eine Aufgabe gelöst werden soll.

Wissenschaftlich wurde dieser Effekt im bahnbrechenden Paper „Language Models are Few-Shot Learners“ (Brown et al., 2020) beschrieben, welches das GPT-3-Modell vorstellte. Die Forscher zeigten, dass LLMs massive Leistungssteigerungen erzielen, wenn sie im Prompt Beispiele (Demonstrationen) sehen, ohne dass auch nur ein einziger Parameter des Modells aktualisiert wird.

- Der Prozess: Du trainierst das Modell quasi im Moment der Anfrage und gibst ihm eine Vorlage, an der es sich orientieren kann.

- Das Ergebnis: Diese Methode führt zu deutlich besseren und spezifischeren Ergebnissen als Zero-Shot Prompting, insbesondere bei strukturierten Aufgaben oder speziellen Formaten (z.B. JSON-Output).

Der Deep Dive: Warum funktioniert das? Es mag magisch wirken, dass ein Modell durch drei Beispiele plötzlich eine neue Aufgabe „lernt“. Forscher des MIT und der Stanford University haben jedoch gezeigt, dass hier kein echtes Lernen (im Sinne von Gradient Descent) stattfindet. Stattdessen nutzt das Modell die Beispiele zur „Task Location“ (Aufgabenverortung). Das Modell besitzt die Fähigkeit bereits im latenten Raum; die Beispiele dienen lediglich als Koordinaten, um diesen spezifischen Bereich zu aktivieren.

Ein weiterer Erklärungsansatz sind die sogenannten Induction Heads (Induktions-Köpfe), die von Forschern bei Anthropic identifiziert wurden. Dies sind spezialisierte Aufmerksamkeits-Mechanismen (Attention Heads) im neuronalen Netz, die Muster wie [A][B] … [A] -> [?] erkennen und vervollständigen. Wenn Sie im Few-Shot Prompting das Muster „Frage -> Antwort“ dreimal wiederholen, aktivieren sich diese Induction Heads und zwingen das Modell, beim vierten Mal genau diesem Muster zu folgen.

Praxis-Implementierung: Obwohl Few-Shot Prompting extrem mächtig ist, erfordert es mehr Vorbereitung, da du zuerst passende Beispiele (Input-Output-Paare) erstellen musst. Die Qualität dieser Beispiele ist entscheidend: Schlechte oder missverständliche Beispiele können die Leistung sogar unter das Niveau von Zero-Shot drücken. Es gilt daher: Experimentiere mit unterschiedlichen Few-Shot-Prompts, um die Qualität der generierten Texte immer weiter zu optimieren.

Die kognitive Wende: Reasoning Elicitation

Bis zum Jahr 2022 galt in der KI-Forschung ein ungeschriebenes Gesetz: Je größer das Modell, desto besser die Antwort. Doch eine spezifische Klasse von Problemen – mathematische Textaufgaben, symbolische Logik und Common-Sense-Reasoning – blieb selbst für gigantische Modelle wie GPT-3 eine unüberwindbare Hürde. Die Antwort lag nicht in mehr Parametern, sondern in einer fundamentalen Änderung der Interaktionsstruktur: Dem Übergang vom reinen Antwort-Abruf zum aktiven Gedankengang.

Chain-of-Thought (CoT): Das Entfesseln des inneren Monologs

Das Chain-of-Thought (CoT) Prompting markiert den vielleicht wichtigsten Wendepunkt in der Geschichte des Prompt Engineering. Anstatt das Modell zu zwingen, direkt von der Frage zur Antwort zu springen (Mapping $Input \rightarrow Output$), fordern wir es auf, seine Gedankengänge bei der Lösung einer Aufgabe zu explizieren.

Das Modell generiert dabei eine Sequenz von Zwischenschritten, bevor es das finale Ergebnis ausgibt. Diese Technik, die erstmals umfassend von Wei et al. (Google Brain, 2022) in ihrem Paper „Chain-of-Thought Prompting Elicits Reasoning in Large Language Models“ beschrieben wurde, verändert die Arbeitsweise des neuronalen Netzes grundlegend.

Der Deep Dive: Warum funktioniert das?

In einem Standard-Prompt muss das Modell die gesamte logische Arbeit „im Dunkeln“ leisten – in den verborgenen Schichten des neuronalen Netzes – und sofort das Ergebnis-Token produzieren. Bei CoT erlauben wir dem Modell, zusätzliche Rechenzeit (Compute) zu nutzen. Jedes Wort, das das Modell im Gedankengang generiert, wird Teil des Kontextes für das nächste Wort.

- Fehler-Aufdeckung: Durch die Verbalisierung des Lösungsweges werden Logikfehler sichtbar, bevor sie das Endergebnis korrumpieren.

- Komplexitäts-Bewältigung: CoT eignet sich besonders für Probleme, die mehrere sequentielle Denkschritte erfordern, da es das große Problem in handhabbare Teilprobleme zerlegt.

Zero-Shot CoT: Der „Let’s think step by step“-Hack

Während Wei et al. noch auf Few-Shot-Beispiele setzten, entdeckten Kojima et al. (2022) eine faszinierende Eigenschaft: Modelle sind „Zero-Shot Reasoners“. Durch das bloße Anhängen der magischen Phrase „Let’s think step by step“ (Lass uns Schritt für Schritt nachdenken) aktiviert das Modell seine Reasoning-Fähigkeiten, ohne dass wir ihm Beispiele geben müssen. Dies ist oft der effizienteste Einstieg in komplexes Prompting, auch wenn die Ergebnisse variabler sein können als bei manuell kuratierten Beispielen.

Self-Consistency: Die Weisheit der Vielen (im Kopf)

Sobald wir akzeptieren, dass LLMs probabilistisch (wahrscheinlichkeitsbasiert) arbeiten, erkennen wir ein Problem bei CoT: Ein einziger Gedankengang kann falsch abbiegen. Ein kleiner Rechenfehler am Anfang ruiniert das gesamte Ergebnis. Die Lösung lieferte Wang et al. (2022) mit der Technik der Self-Consistency.

Diese Methode baut direkt auf dem CoT-Prompting auf, verändert aber den Decoding-Prozess. Anstatt das Modell nur einmal zu fragen (Greedy Decoding), senden wir denselben Prompt mehrfach an das Modell – oft mit leicht variierten Formulierungen oder einer höheren „Temperature“ (einem Parameter, der die Kreativität/Zufälligkeit der Ausgabe steuert).

- Der Prozess: Das Modell generiert für jeden Prompt eine eigene Antwort inklusive eines einzigartigen Lösungsweges. Am Ende wählt ein Algorithmus (oder wir manuell) die Antwort aus, die am häufigsten vorkommt (Majority Voting).

- Die Logik dahinter: LLMs machen Flüchtigkeitsfehler oft zufällig, aber die korrekte Logik ist robust. Wenn wir 10 Antworten generieren, werden die 3 falschen Antworten wahrscheinlich auf 3 unterschiedliche Arten falsch sein, während die 7 richtigen Antworten alle auf demselben Ergebnis konvergieren.

- Anwendung: Durch die Betrachtung mehrerer Lösungswege und die Auswahl der konsistentesten Antwort können Fehler drastisch reduziert und die Genauigkeit verbessert werden. Dies eignet sich besonders für Aufgaben mit einer eindeutigen Lösung (z.B. Mathematik), bei denen der Weg dorthin aber variieren kann.

Strategische Zerlegung: Algorithmisches Denken

Während Chain-of-Thought das Modell dazu anregt, seine Gedanken frei fließen zu lassen, stoßen wir bei Aufgaben mit hoher kompositorischer Komplexität an eine Grenze. Wenn ein Problem zu viele Variablen enthält oder die logische Kette zu lang wird, verliert das Modell oft den Faden – ein Phänomen, das Forscher als „Lost in the Middle“ beschreiben. Um dies zu verhindern, müssen wir das Modell zwingen, nicht nur zu denken, sondern zu planen. Wir bewegen uns hier weg von der menschlichen Intuition hin zu einer algorithmischen Strenge.

Least-to-Most Prompting: Die Kunst der Dekomposition

Das von Google Research (Zhou et al., 2022) vorgestellte Least-to-Most Prompting adressiert spezifisch solche Probleme, die die kognitive Kapazität eines einzelnen Durchlaufs sprengen. Es basiert auf der fundamentalen Informatik-Strategie des „Divide and Conquer“.

Anstatt das Modell mit der vollen Komplexität einer Anfrage zu konfrontieren, wird das Problem in mehrere einfachere Teilprobleme zerlegt. Das Verfahren ist streng sequentiell: Das Sprachmodell wird zunächst aufgefordert, diese Teilprobleme zu identifizieren und zu lösen, bevor es sich der Gesamtlösung widmet.

Der Mechanismus: Der Name „Least-to-Most“ bezieht sich darauf, dass das Modell mit den einfachsten Teilproblemen beginnt und sich dann zu den komplexeren Aspekten vorarbeitet.

- Dekomposition: Der erste Prompt fragt: „Welche Unterfragen müssen beantwortet werden, um [Hauptfrage] zu lösen?“

- Sequentielle Lösung: Die Antwort auf Unterfrage 1 wird an den Prompt für Unterfrage 2 angehängt.

- Synthese: Die finalen Antworten bauen auf dem kumulierten Kontext aller vorherigen Schritte auf.

Der Deep Dive: Warum ist das effizienter als Standard-CoT? Bei einer langen CoT-Kette können sich Fehler akkumulieren. Durch die schrittweise Lösung der Teilprobleme kann das Modell jedoch ein besseres Verständnis für das Gesamtproblem entwickeln und eine präzisere Antwort generieren. Es verankert („groundet“) jede Teilantwort in der Realität, bevor es den nächsten logischen Sprung wagt. Diese Technik ist unerlässlich für Aufgaben, die eine symbolische Manipulation oder das Verarbeiten extrem langer Texte erfordern.

Plan-and-Solve (PS): Strategie vor Taktik

Eine weitere Evolution in der Steuerung komplexer Denkprozesse ist Plan-and-Solve (PS). Diese Technik wurde entwickelt, um die oft unstrukturierte Natur von Chain-of-Thought zu disziplinieren. Während CoT oft „drauflos denkt“ und dabei in Sackgassen geraten kann, zwingt PS das Modell zur strategischen Voraussicht.

Plan-and-Solve konzentriert sich auf die Lösung komplexer Probleme, indem zunächst ein expliziter Plan erstellt und dann schrittweise ausgeführt wird. Der Prompt enthält Anweisungen wie „Erstelle zuerst einen Plan und führe ihn dann aus“.

Der Prozess: Bei PS wird das Sprachmodell aufgefordert, das Problem zu analysieren, einen Lösungsplan zu entwickeln und diesen Plan dann Schritt für Schritt umzusetzen.

- Planungsphase: Das Modell listet die notwendigen Schritte auf, ohne sie sofort zu berechnen. Dies trennt die Logik der Lösung von der Ausführung.

- Ausführungsphase: Das Modell arbeitet die selbst erstellte Liste ab.

Der Hauptvorteil von PS besteht darin, dass es dem Modell ermöglicht, eine strukturierte Herangehensweise an komplexe Probleme zu entwickeln. Durch die Erstellung eines Plans kann das Modell die wichtigsten Schritte identifizieren und sich auf die wesentlichen Aspekte des Problems konzentrieren, anstatt sich in irrelevanten Details zu verlieren.

Wissenschaftliche Einordnung: In Benchmarks zeigte sich, dass Plan-and-Solve (insbesondere die Variante PS+, die detailliertere Instruktionen enthält) oft die Fehlerquote bei mathematischen Reasoning-Aufgaben im Vergleich zu Zero-Shot-CoT signifikant senkt. Es verhindert sogenannte „Calculation Errors“ und „Missing Step Errors“, da der Plan als Checkliste dient, die das Modell mental „abhaken“ muss.

Die Brücke zum Code: Tool-Use & Automation

Wir haben gesehen, wie wir LLMs das Denken (Reasoning) lehren können. Doch es bleibt eine fundamentale Schwäche: Large Language Models sind keine Rechenmaschinen. Sie sind Text-Vorhersage-Systeme. Wenn man ein Modell fragt: „Was ist 1337 mal 42?“, rechnet es nicht, sondern es rät das nächste Token basierend auf Wahrscheinlichkeiten. Für präzise mathematische oder logische Operationen ist „Sprache“ oft das falsche Werkzeug. Hier betreten wir die Ära des Tool-Use, in der das Modell lernt, externe Werkzeuge zu nutzen, anstatt alles selbst zu simulieren.

Program-of-Thoughts (PoT): Wenn Sprache nicht präzise genug ist

Program-of-Thoughts (PoT) ist eine radikale Abkehr vom bisherigen Paradigma. Diese Prompting-Technik basiert auf der Erkenntnis, dass komplexe Probleme oft leichter zu lösen sind, wenn man sie in eine formale Logik übersetzt. Anstatt das Modell zu zwingen, eine Rechenaufgabe in einem natürlichsprachlichen Aufsatz zu lösen (wie bei CoT), nutzen wir die Stärke des Modells in einer anderen Domäne: dem Coding.

Der Mechanismus: Bei PoT wird das Sprachmodell aufgefordert, ein Programm oder einen Algorithmus zu generieren, der das Problem schrittweise löst. Im Gegensatz zu Chain-of-Thought, bei dem das Modell den Lösungsweg in natürlicher Sprache beschreibt, verwendet PoT eine strukturiertere, oft Python-basierte Darstellung.

- Modularität: Jeder logische Schritt wird als eigenständige Funktion oder Variable definiert, die einen spezifischen Teilaspekt des Problems löst.

- Ausführung: Durch die Kombination dieser Teilschritte wird eine vollständige Lösung erreicht, wobei die eigentliche „Arbeit“ (das Rechnen) nicht vom LLM, sondern von einem deterministischen Code-Interpreter (z.B. Python) ausgeführt wird.

Der Deep Dive: PoT entkoppelt das Logische Planen (die Stärke des LLM) von der Deterministischen Ausführung (die Schwäche des LLM). Das Modell agiert hier nicht als Gelehrter, sondern als Programmierer. Es schreibt den Code, der die Antwort berechnet. Das eliminiert Halluzinationen in Rechenaufgaben fast vollständig. In der Praxis ist dies die Basis für moderne Agenten-Systeme (wie den OpenAI Code Interpreter), die Datenanalysen durchführen, indem sie Code schreiben und im Hintergrund ausführen.

Automatic Chain-of-Thought (Auto-CoT): Skalierung durch Rekursion

Ein großes Hindernis beim fortgeschrittenen Prompting ist der menschliche Flaschenhals. Hochwertiges Few-Shot Prompting erfordert, dass Experten perfekte Beispiele schreiben. Automatic Chain-of-Thought (Auto-CoT) ist eine Weiterentwicklung, die diesen Prozess automatisiert, indem die Beispiele für das Few-Shot Prompting nicht mehr von Menschen, sondern vom Modell selbst generiert werden.

Der Prozess: Anstatt manuell Beispiele zu erstellen, die den Lösungsweg demonstrieren, werden diese von einem Sprachmodell erzeugt.

- Generation: Das Modell nutzt zunächst Zero-Shot-Techniken (z.B. „Let’s think step by step“), um für eine Reihe von Fragen Lösungswege zu generieren.

- Selektion (Clustering): Der Algorithmus analysiert diese generierten Lösungen und wählt diversifizierte Beispiele aus, die verschiedene Arten von Logik repräsentieren.

- Inferenz: Diese automatisch generierten Beispiele werden dann verwendet, um das Modell im finalen Prompt anzuleiten.

Der Vorteil: Der Hauptvorteil liegt in der Skalierbarkeit. Der Aufwand für die Erstellung hochwertiger Few-Shot Prompts wird massiv reduziert. Zudem zeigen Studien (z.B. von Zhang et al., 2022), dass Auto-CoT oft robustere Ergebnisse liefert als manuell kuratierte Beispiele, da die generierten Erklärungen besser auf die interne Repräsentation des Modells abgestimmt sind. Es ist ein System, das sich selbst lehrt, wie es denken soll, ohne dass eine manuelle Kuratierung erforderlich ist.

Abstrakte Effizienz: Symbole und Strukturen

Während wir LLMs primär als Sprach-Maschinen verstehen, stoßen wir in der fortgeschrittenen Anwendung auf ein Paradoxon: Natürliche Sprache ist oft ein ineffizientes Medium für präzise Logik. Sie ist redundant, mehrdeutig und token-intensiv. Wenn wir komplexe räumliche Beziehungen, chemische Strukturen oder hierarchische Abhängigkeiten modellieren wollen, wird der „Text“ zum Hindernis. Hier verlassen wir die Prosa und treten in die Welt der Abstraktion ein.

Chain-of-Symbol (CoS): Die Sprache der Logik

Chain-of-Symbol (CoS) ist eine Prompting-Technik, die darauf abzielt, die Limitationen natürlicher Sprache bei der Verarbeitung symbolischer Informationen zu überwinden. Wenn ein Modell komplexe Szenarien simulieren muss – sei es eine Schachpartie, eine chemische Reaktion oder eine mathematische Topologie –, versagt die wortreiche Beschreibung oft, weil das Modell den Überblick im „Rauschen“ der Füllwörter verliert.

Der Mechanismus: Bei CoS ersetzen wir narrative Beschreibungen durch kondensierte Symbole oder Tokens. Anstatt zu schreiben „Objekt A befindet sich in einer Kiste, die wiederum auf einem Tisch steht“, verwenden wir Symbole, um Beziehungen, Hierarchien oder Abfolgen darzustellen (z.B. {A} -> [Kiste] -> _Tisch_).

Der Deep Dive: Warum steigert das die Intelligenz des Modells? Durch die Verwendung von Symbolen wird die „Informationsdichte“ pro Token maximiert. Das Modell kann komplexe Zusammenhänge und Strukturen besser erfassen und verarbeiten, da der „Abstand“ zwischen den relevanten Informationseinheiten im Attention-Fenster verringert wird. Dies ist besonders nützlich bei Aufgaben, die eine extrem präzise Darstellung von Informationen erfordern, wie mathematische Gleichungen, chemische Formeln oder komplexer Programmiercode, wo ein missverstandenes Wort die gesamte Logik bricht. CoS zwingt das Modell, in abstrakten Repräsentationen zu „denken“, ähnlich wie ein Mathematiker, der Formeln statt Sätze nutzt.

Structured Chain-of-Thought (SCoT): Form folgt Funktion

Während CoS den Input und die Verarbeitung optimiert, revolutioniert Structured Chain-of-Thought (SCoT) den Output. Standardmäßiges Chain-of-Thought (CoT) produziert oft einen „Wall of Text“ – einen fließenden Bewusstseinsstrom, der zwar logisch richtig sein mag, aber schwer zu parsen oder weiterzuverarbeiten ist.

SCoT ist eine Erweiterung des Chain-of-Thought Prompting, bei der die Antwort des Sprachmodells zwingend in einer strukturierten Form generiert wird. Wir erlauben dem Modell nicht mehr, frei zu fabulieren.

Der Prozess: Anstatt den Gedankengang in Fließtext zu beschreiben, zwingt SCoT das Modell in eine vorgegebene Struktur, wie z.B. eine Liste, eine Tabelle oder ein Diagramm (oft in Formaten wie JSON, Markdown oder XML).

Der Vorteil: Diese Technik hat zwei massive Vorteile:

- Kognitive Hygiene: Durch die Vorgabe einer Struktur wird das Modell dazu gebracht, seine Antwort besser zu organisieren und wichtige Informationen explizit hervorzuheben, anstatt sie im Text zu vergraben. Das Skelett der Antwort erzwingt eine logische Gliederung.

- Interoperabilität: Dies verbessert nicht nur die Übersichtlichkeit für den menschlichen Leser, sondern macht die KI-Antwort auch maschinenlesbar. Ein SCoT-Prompt, der JSON ausgibt, kann direkt von einer API weiterverarbeitet werden, was SCoT zur bevorzugten Technik für Software-Integrationen macht.

Fazit & Learning

Vom Prompt Engineer zum AI Architect

Wir haben eine weite Reise von der einfachen Eingabeaufforderung hin zu komplexen, selbstreferenziellen Systemen zurückgelegt. Was bleibt, ist eine fundamentale Erkenntnis: Prompt Engineering ist keine Magie, sondern angewandte Informatik in natürlicher Sprache.

Die Zeiten, in denen wir KI als bloße Suchmaschine oder Textgenerator betrachtet haben, sind vorbei. Mit Techniken wie Chain-of-Thought und Plan-and-Solve verwandeln wir das Modell von einem statischen Wissensspeicher in eine kognitive Engine, die plant, schlussfolgert und Code ausführt.

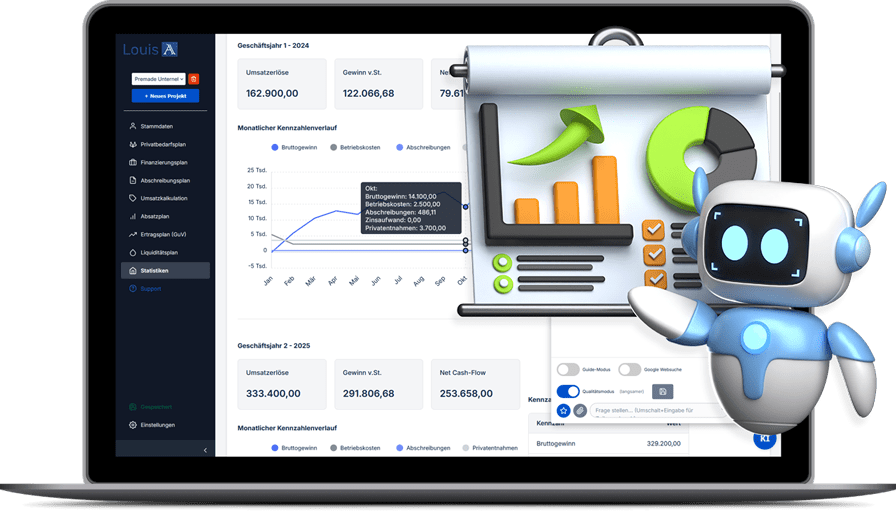

Für Unternehmen bedeutet dies: Die Implementierung von KI ist kein reines Software-Problem mehr, sondern ein Prozess-Problem. Wer komplexe Workflows automatisieren will, muss diese zunächst in algorithmische Schritte zerlegen. Die Wahl der richtigen Prompting-Strategie entscheidet darüber, ob ein Chatbot halluziniert oder ob er verlässliche Geschäftsprozesse steuert.

Für Angestellte und Entwickler heißt das: Die Fähigkeit, Probleme zu dekomponieren (wie beim Least-to-Most Prompting) und in logische Module zu übersetzen (wie beim Program-of-Thoughts), wird zur entscheidenden Meta-Kompetenz des 21. Jahrhunderts. Wir entwickeln uns von „Usern“ zu „AI Architects“, die kognitive Pipelines entwerfen.

Welche Technik nutzen Sie wann? Hier ist die finale Heuristik für Ihre tägliche Arbeit:

- Exploration & Einfache Aufgaben: Nutzen Sie Zero-Shot Prompting, um Fähigkeiten schnell auszutesten. Reicht die Qualität nicht, wechseln Sie sofort zu Schritt 2.

- Spezifische Formate & Stil: Wenn das Modell eine bestimmte Struktur oder Tonalität treffen muss, nutzen Sie Few-Shot Prompting als Trainings-Ersatz.

- Logik & Schlussfolgerung: Sobald die Aufgabe Nachdenken erfordert („Warum ist X so?“), erzwingen Sie mit Chain-of-Thought (CoT) die Verbalisierung des Lösungsweges.

- Hohe Präzision & Sicherheit: Bei kritischen Entscheidungen nutzen Sie Self-Consistency. Lassen Sie das Modell fünfmal antworten und wählen Sie die Mehrheit.

- Maximale Komplexität: Wenn das Problem den Kontext sprengt, zerlegen Sie es mit Least-to-Most oder Plan-and-Solve in Teilschritte.

- Mathematik & Daten: Trauen Sie keinem Wort, sondern dem Code. Nutzen Sie Program-of-Thoughts (PoT) für alles, was berechnet werden muss.

Akademische Primärquellen

- Brown et al. (2020): Language Models are Few-Shot Learners. (Grundlage für Few-Shot Prompting).

- Wei et al. (2022): Chain-of-Thought Prompting Elicits Reasoning in Large Language Models. (Grundlage für CoT).

- Wang et al. (2022): Self-Consistency Improves Chain of Thought Reasoning in Language Models.

- Kojima et al. (2022): Large Language Models are Zero-Shot Reasoners. (Grundlage für „Let’s think step by step“).

- Zhou et al. (2022): Least-to-Most Prompting Enables Complex Reasoning in Large Language Models.

- Chen et al. (2022): Program of Thoughts Prompting: Disentangling Computation from Reasoning for Numerical Reasoning Tasks.